Alibaba réduit les coûts de recherche de 90 % avec une nouvelle méthode d’entraînement IA

Alibaba a présenté ZEROSEARCH, une nouvelle approche d’entraînement des grands modèles de langage (LLM) qui réduit considérablement les coûts liés à l’apprentissage des tâches de recherche.

Cette méthode élimine les appels coûteux aux API de moteurs de recherche commerciaux en apprenant aux modèles à imiter le fonctionnement des moteurs de recherche, ce qui permet de réduire les dépenses d’entraînement de près de 90 % et de rendre les fonctionnalités avancées de recherche par IA plus accessibles.

« En réduisant drastiquement les coûts liés à l’entraînement des LLM pour simuler le comportement des moteurs de recherche, nous permettons aux développeurs et aux entreprises, y compris les PME, de concevoir leur propre cadre d’apprentissage par renforcement sans dépendre de services de recherche tiers coûteux », déclare Huang Fei, directeur du Tongyi Natural Language Processing Lab chez Alibaba.

Réduire les obstacles pour les développeurs et les entreprises

La capacité à effectuer des recherches pertinentes est essentielle pour améliorer les capacités de raisonnement et de réponse des modèles. Mais les approches traditionnelles d’apprentissage par renforcement (RL) nécessitaient des centaines de milliers d’interactions avec des moteurs de recherche en ligne, via des appels API coûteux, ce qui représente un frein important à la scalabilité. De plus, la qualité variable des résultats récupérés affectait souvent la cohérence de l’entraînement.

Simuler la recherche de manière efficace et abordable

Pour contourner ces difficultés, ZEROSEARCH d’Alibaba repose sur une stratégie de simulation en deux étapes visant à supprimer le besoin de requêtes API :

- Un affinement supervisé permet de transformer le LLM en moteur de recherche simulé pour générer des documents pertinents face à une requête utilisateur.

- Un entraînement progressif est utilisé pendant la phase d’apprentissage par renforcement, pour dégrader volontairement la qualité des documents simulés, poussant le modèle à s’adapter et à ajuster ses réponses.

Lors des tests, les modèles entraînés avec ZEROSEARCH ont obtenu des performances égales ou supérieures à ceux formés via des API de recherche réelles. Par exemple, un module de recherche Qwen2.5-7B a montré des résultats comparables à ceux de Google Search, tandis qu’un module plus grand de 14B l’a surpassé tout en réduisant les coûts d’entraînement de 88 %.

S’engager pour une IA ouverte et économique

Pour proposer une IA plus ouverte et accessible, Alibaba publie en open source plusieurs modèles d’IA de tailles, de langues et de modalités variées, permettant aux développeurs de créer leurs propres solutions personnalisées à moindre coût.

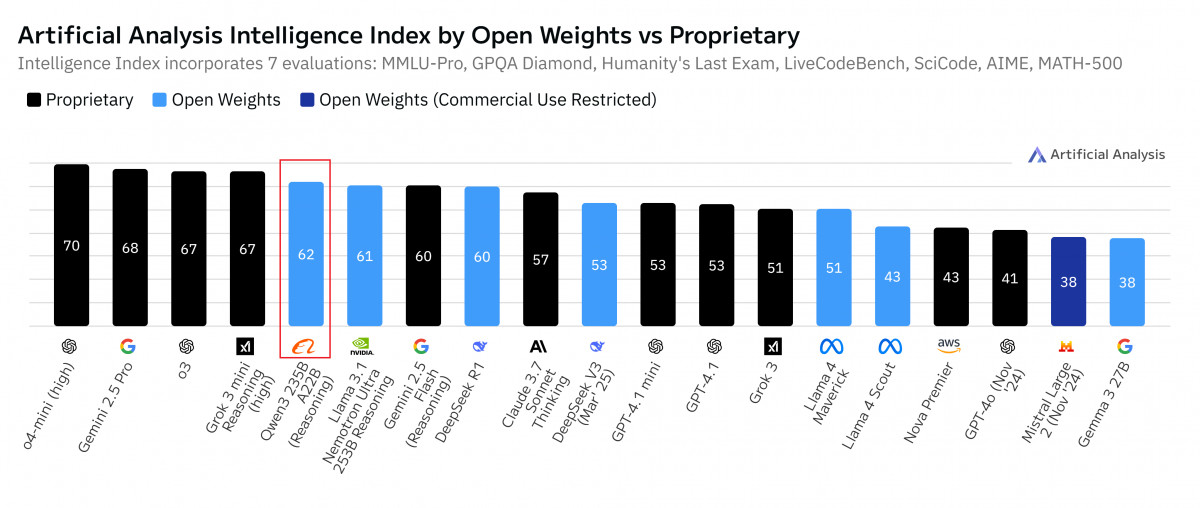

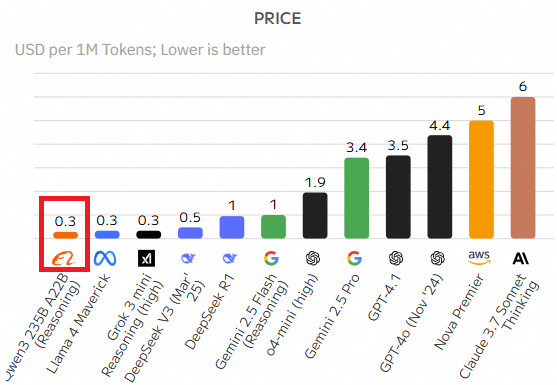

Selon une évaluation menée par Artificial Analysis, une structure indépendante reconnue dans le domaine de l’analyse des modèles d’IA, le modèle Qwen3-235B-A22B d’Alibaba se classe cinquième en Intelligence globale (mathématiques, code, raisonnement, sciences) et premier en rapport coût-efficacité.

Laisser un commentaire